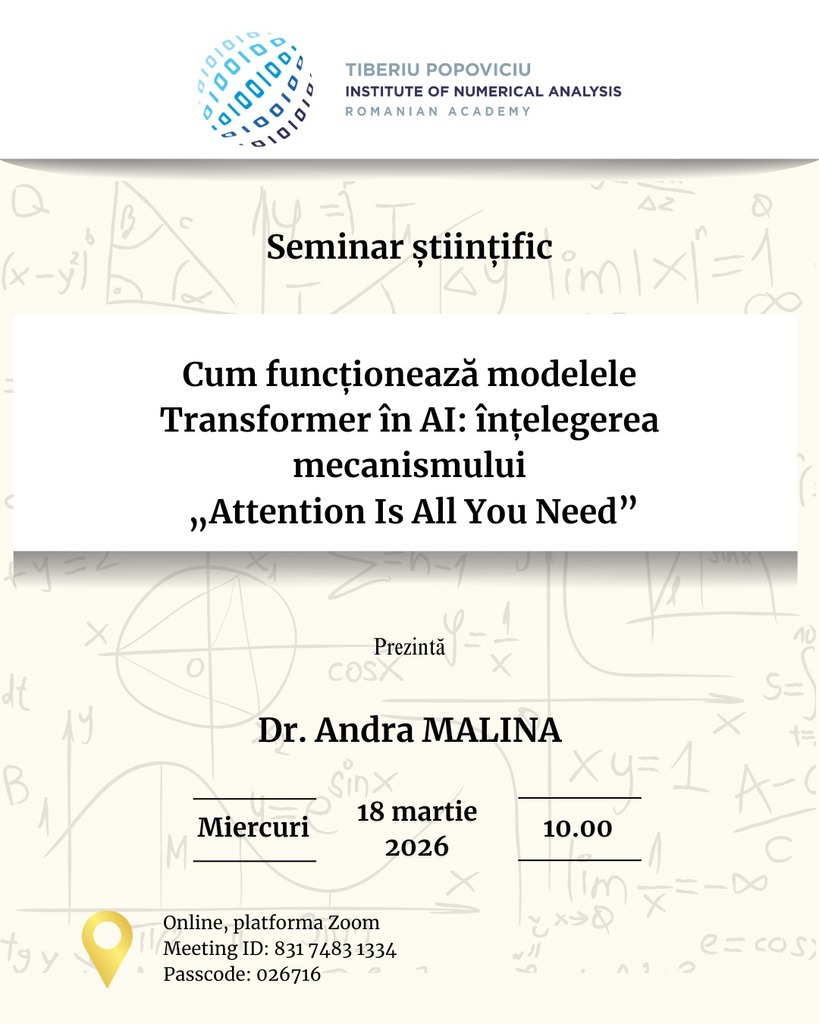

Miercuri 18 martie 2026 de la ora 10, dr. Andra Malina va susține o prezentare la Seminarul Institutului cu titlul

Cum funcționează modelele Transformer în AI: înțelegerea mecanismului „Attention Is All You Need”

Rezumat: Această prezentare introduce conceptele fundamentale care stau la baza Modelelor Mari de Limbaj (LLM) moderne, urmărind evoluția de la procesarea de bază a limbajului natural (NLP) și reprezentările vectoriale ale cuvintelor (word embeddings), până la arhitectura Transformer, introdusă de Vaswani et al. în 2017. Punctul central al prezentării îl reprezintă mecanismul de auto-atenție (self-attention), care le permite modelelor să surprindă simultan relațiile dintre toate cuvintele dintr-o secvență, facilitând astfel înțelegerea și generarea eficientă și scalabilă a limbajului.

Zoom: Conferința va putea fi urmărită și pe Zoom prin linkul de acces

sau folosind detaliile de mai jos

Meeting ID: 831 7483 1334

Passcode: 026716